谷歌开源Coral NPU重构边缘AI范式, 解决终端终端AI痛点

10月22日消息,谷歌CoralNPU(神经网络处理器)正式亮相,凭借毫瓦级能效比的核心突破,为终端AI部署带来关键变革,同时以全栈开源生态解决行业多年痛点,目前已在消费电子、健康监测等领域落地。

从核心性能来看,CoralNPU的“AI优先架构”是关键:在输出512GOPS(每秒512亿次操作)算力时,功耗仅为毫瓦级,较传统终端算力方案能效比提升百倍。

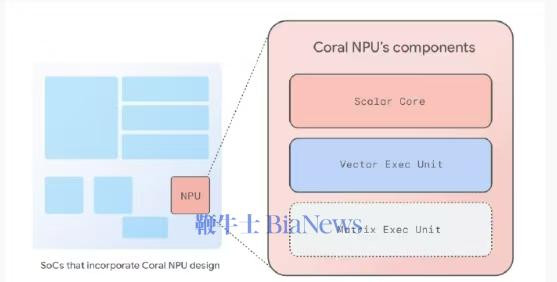

硬件设计上,它跳出CPU为中心的传统思路,将矩阵引擎(支持外积乘积累加运算,专攻神经网络加速)置于核心,再搭配标量核心(RISC-V控制单元)与向量引擎(RISC-VRVV1.0指令集),形成高效算力组合。

针对行业普遍面临的碎片化、性能、隐私、门槛问题,CoralNPU给出了全栈解决方案:

用统一编译器堆栈(MLIR/IREE/TFLiteMicro)消除硬件碎片化,开发者一次写码就能跨设备部署;

靠AI专用加速架构填补性能鸿沟,让手表、耳机这类小功耗设备也能运行Transformer模型;

通过CHERI内存隔离的硬件强制安全设计,实现数据本地处理,抵御内存攻击,保障隐私;

同时兼容TensorFlow、PyTorch、JAX主流框架,开发者无需重写模型代码,大幅降低门槛。

应用落地已初见成效,在消费电子领域,它能支撑实时翻译耳机全天候运行语言模型、AR眼镜毫秒级完成物体识别;可助力智能手表持续分析生物传感器数据,进行健康监测;工业物联网方向,Synaptics已推出基于Coral架构的AstraSL2600系列处理器。

值得关注的是,CoralNPU不仅终结终端AI对云端的依赖,让环境AI(AmbientAI)实现无网实时响应,还成为首个为可穿戴设备优化的开放NPU架构,同时敏感数据本地留存的特性,也符合GDPR等严格法规。

目前,其架构文档、编译器工具链、模拟器已在GitHub开源。(转自AI普瑞斯)