前劳斯莱斯设计师手笔! 荣威M7DMH实车亮相! 气质高雅!

前2天才静悄悄公布荣威M7 DMH的内饰官图,今天突然实车亮相了,估计迫不及待跟大家见面吧,当看到实车那一刻,就觉得这车能成,整体造型很高雅,前脸设计很有辨识度,开出去瞬间沦为焦点。

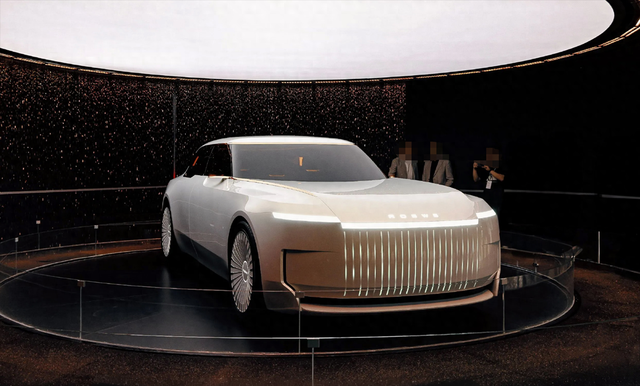

快来瞧瞧荣威M7 DMH的前身,明珠概念车,新车基于概念车衍生设计,的确别有一番风味。

听说劳斯莱斯设计师约瑟夫·卡班跳槽上汽后憋了个大招?最近他操刀的首款量产车荣威M7 DMH实车正式亮相,定位“越级中大型国民车”,主打一个“用B级价格享受C级待遇”。

豪车基因,气场两米八。前脸亮眼的直瀑式格栅+矢量光轨日行灯,配上发光LOGO和迎宾光毯,车主回家停车都像走红毯,仪式感满满。侧面溜背车身+实体门把手+近5米车长(4940mm),轴距2820mm,约126mm后排膝部空间,后排随意入座,网友调侃:“这尺寸,确定不是来抢BBA饭碗的?”

移动沙发房,还能一键躺平?内饰主打“乳胶感慕斯云翼座椅”,511mm加长坐垫+慢回弹海绵,官方形容“亲肤如猫肚皮”。副驾首创水平折叠模式,秒变沙发床-开启懒人躺模式。主驾一键开启“大躺/小憩模式”,打工人午休神器+1!搭配256色氛围灯+流云纹饰板,夜间直接变身赛博茶馆。

座舱内置AI大模型语音助手,支持华为/小米/苹果等多品牌手机互联,大中控屏操作“动口不动手”。建议荣威下次更新时加入“帮我写汽车文案”功能(疯狂暗示)。还有527L后备箱和手机无线充电面板。内饰提供2种颜色(玛瑙米、灰色)。

将搭载第五代DMH混动系统,纯电续航160km(上班一周不加油),综合续航2050km(广州到上海中途不充电)。网友灵魂拷问:“油箱是哆啦A梦口袋做的?”

幽默结尾:设计靠大佬,续航猛如豹,座椅能躺倒,就差价格好!

新车预计在今年下半年上市,估计比荣威D7贵点吧

预测价格14万起,大家觉得呢?